Was bringt dir eine Million Website-Besucher, wenn 90% davon Bots sind?

Und was passiert, wenn du auf Basis dieser Zahlen dein Marketingbudget planst?

Genau das erleben wir regelmässig bei Kunden, die zu uns kommen: beeindruckende Zugriffszahlen, aber kaum Anfragen. Die Conversion Rate im Keller. Und eine Marketing-Abteilung, die verzweifelt versucht, das «Engagement-Problem» zu lösen – das in Wirklichkeit gar nicht existiert.

Das eigentliche Problem: SPAM Traffic verfälscht die Daten so stark, dass jede Analyse zur Kaffeesatzleserei wird.

In diesem Artikel zeigen wir dir, wie du SPAM Traffic erkennst, welche Lösungen es gibt – und warum saubere Daten die Grundlage für jede sinnvolle Marketingentscheidung sind.

Du lernst:

✅ Warum SPAM Traffic ein wachsendes Problem ist – und was er mit deinen Daten macht

✅ Wie du Fake-Traffic in deinen GA4-Reports erkennst

✅ Welche Lösungen es gibt – inklusive ihrer Grenzen

✅ Warum serverseitiges Tracking die nachhaltigste Lösung ist

✅ Was mit sauberen Daten plötzlich alles möglich wird

Warum saubere Daten kein «Nice-to-have» sind

Bevor wir über SPAM Traffic sprechen, müssen wir über etwas Grundlegenderes reden: die Qualität deiner Daten.

Dr. Tom Alby bringt es auf den Punkt: «Daten sind kein Selbstzweck. Sie sind nur dann wertvoll, wenn klar ist, was sie messen, was sie nicht messen und welche Entscheidungen sie tragen können.»

Das klingt banal, hat aber weitreichende Konsequenzen: Viele Unternehmen scheitern nicht an fehlender Technologie, sondern daran, dass Daten falsch interpretiert, überschätzt oder unkritisch weitergereicht werden.

Eine Studie im Journal of Marketing Analytics (2025) zeigt: Die Qualität von Marketing-Daten hat einen direkten Einfluss auf die Agilität von Unternehmen. Schlechte Daten führen zu schlechten Entscheidungen – und schlechte Entscheidungen kosten Geld, Zeit und Marktanteile.

Oder wie Tom Alby es formuliert: «Korrelation ist nicht Kausalität. Dashboards ersetzen kein Denken.»

Das Problem: SPAM Traffic in GA4

Zum Start von GA4 (2020) war die Freude gross. Im Google Support Center steht, dass «Traffic von bekannten Bots und Spider automatisch ausgeschlossen» wird.

Die Realität sieht anders aus.

Laut Imperva stammen 47,4% des gesamten Internet-Traffics von Bots – nicht von Menschen. Google filtert zwar bekannte Bots gemäss der IAB-Liste, aber viele fallen durch das Raster.

Warum ist das seit 2023 schlimmer geworden?

Seit dem Shutdown von Universal Analytics im Juli 2023 nutzt die Welt GA4 – und plötzlich wurde es wieder interessant für Spammer, GA4-Properties zuzuspammen. Das Resultat: falscher Traffic, Referral Spam und Fake-Sessions überfluten die Berichte.

Erschwerend kommt hinzu: Durch Zero-Click-Searches und AI Overviews sinkt der echte organische Traffic. Wenn dein realer Traffic von 5’000 auf 2’500 Besucher schrumpft, machen dieselben 100 SPAM-Sessions plötzlich 5% deiner Daten aus statt 1%.

Bist du auch von SPAM Traffic betroffen?

47,4% des gesamten Internet-Traffics stammt von Bots. Das heisst nicht, dass knapp die Hälfte deines Traffics von Bots stammt. Google filtert einige bekannte Bots raus, aber leider nicht alle. Wenn du dir nicht sicher bist ob auch du von SPAM Traffic betroffen bist, kannst du das das gleich hier kurz prüfen:

Kostenloser Google Analytics Audit

Wir nehmen dein Analytics Konto kostenlos unter die Lupe, fülle einfach das untenstehende Formular aus und wir melden uns bei dir:

Du bist unsicher, wie stark deine Daten betroffen sind? Wir prüfen dein Google Analytics Setup und zeigen dir, wo die grössten Datenqualitäts-Probleme liegen – kostenlos und unverbindlich.

So erkennst du SPAM Traffic in deinen Daten

Die Screenshots sprechen für sich

Hier ein reales Beispiel aus unserer Praxis:

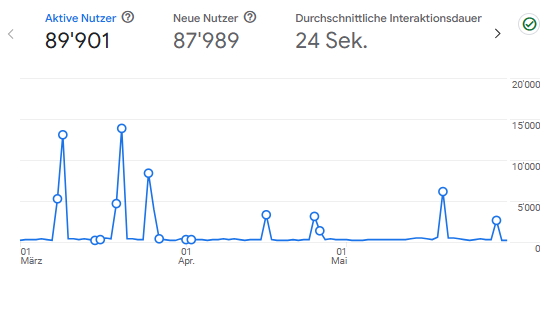

Screenshot 1: Extreme Ausschläge ohne Erklärung

89’901 aktive Nutzer, aber nur 24 Sekunden durchschnittliche Interaktionsdauer. Die Spikes (bis 20’000 Nutzer an einzelnen Tagen) haben keine erklärbare Ursache – keine Kampagne, keine Medienpräsenz, nichts.

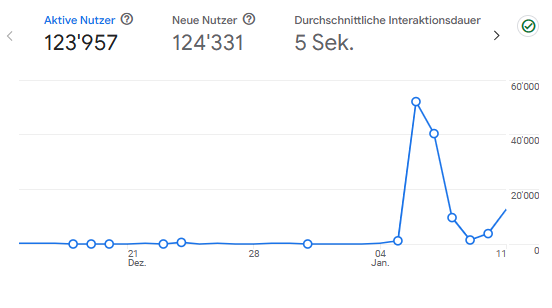

Screenshot 2: Der mathematische Beweis

124’331 neue Nutzer bei nur 123’957 aktiven Nutzern. Das ist mathematisch unmöglich bei echtem Traffic. Dazu eine Interaktionsdauer von nur 5 Sekunden. Das ist kein Engagement-Problem – das ist SPAM.

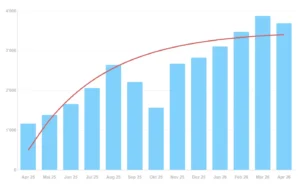

Screenshot 3: Plötzlicher Daueranstieg

1,4 Millionen aktive Nutzer klingt beeindruckend. Aber ab Oktober verdoppelt sich der Traffic plötzlich – ohne jede Marketing-Massnahme. Klassisches Bot-Verhalten.

Die typischen Warnsignale

Du erkennst du SPAM Traffic an:

🚩 Null Engagement bei hohen Nutzerzahlen: Viele Sessions mit 0 Sekunden Interaktionsdauer

🚩 Mehr neue als aktive Nutzer: Mathematisch unmöglich bei echtem Traffic

🚩 Extreme Ausschläge an einzelnen Tagen: Ohne erklärbare Kampagne oder Medienberichterstattung

🚩 Verdächtige Referral-Quellen: Domains wie «wake-up-network.com oder urlumbrella.com» oder unbekannte Verweisseite

🚩 Traffic aus Ländern, die du nicht bedienst: Plötzlich tausende Besucher aus China oder Singapur

🚩 Immer gleiche Session-Zahlen: Echte Traffic-Muster schwanken natürlich

Die Konsequenzen: Warum SPAM Traffic gefährlich ist

SPAM Traffic ist nicht nur ein Ärgernis – er sabotiert deine gesamte Marketingstrategie.

1. Falsche Wachstumssignale

Wenn dein Traffic-Report +50% zeigt, feierst du vielleicht – bis du merkst, dass die Hälfte davon Bots waren. Noch schlimmer: Du präsentierst diese Zahlen der Geschäftsleitung und musst später zurückrudern.

2. Kaputte Engagement-Metriken

SPAM-Sessions mit null Engagement ziehen deinen Durchschnitt nach unten. Plötzlich zeigen die Daten eine Interaktionsdauer von 5 Sekunden, obwohl echte Nutzer 3 Minuten auf deiner Seite verbringen. Du optimierst an der falschen Stelle.

3. Ungültige A/B-Tests

Search Engine Land warnt: «Spam traffic in A/B test variants invalidates your conclusions.» Du rollst eine «gewinnende» Variante aus, die nur deshalb besser performte, weil Bots anders mit ihr interagierten.

4. Falsche Content-Priorisierung

Deine «Top-Performing»-Seiten sind vielleicht nur Bot-Magneten. Du produzierst mehr davon – während echter, wertvoller Content vernachlässigt wird.

5. KI-Analysen werden unbrauchbar

Wir arbeiten zunehmend mit KI, um Marketingdaten zu analysieren. SPAM-Traffic verfälscht die gesamte Historie – und damit jede KI-basierte Prognose oder Empfehlung.

SPAM Traffic aus Berichten filtern

Auch wenn du jetzt Massnahmen ergriffen hast, damit du künftig weniger SPAM Traffic in deinen Bericht hast, ändert das nichts an den bestehenden Berichten. Da ist dieser unechte Traffic immer noch sichtbar. Historische Daten bereinigen – die ehrliche Wahrheit

GA4 erlaubt keine nachträgliche Löschung von Daten. Du kannst in den Explorativen Datenanalysen Segmente erstellen, um bekannte Spam-Quellen auszufiltern – aber das funktioniert nur bei einem Teil des Problems.

Was hilft:

- Hostname-Filter auf deine Domain → filtert Ghost-Traffic

- Bekannte Spam-Referrer per Regex ausschliessen

Was nicht filterbar ist:

- Bots, die als «Direct» oder «Organic» getarnt sind

- SPAM mit korrektem Hostname und ohne verdächtigen Referrer

Deshalb gilt: Prävention ist wichtiger als Bereinigung. Mit Server-Side Tracking verhinderst du, dass SPAM-Traffic überhaupt erst erfasst wird.

Wie du diesen rausfilterst in GA4 rausfiltern kannst, haben wir hier beschrieben:

Wir haben im Video folgende Regeln erstellt:

Land stimmt mit Regex überein:

.*(Switzerland|Germany|Austria|Liechtenstein).*Seitenverweis stimmt nicht mit Regex überein:

.*(grets|seders|fertuk|bartikus|dertus|mantero|razas|trafficpeak|rida\.tokyo|hiwpro|jackonline|blogtrafficeasily|erias|urlumbrella).*Hostname enthält oder ist gleich:

dein eigener Domainname

Die Lösungen – und ihre Grenzen

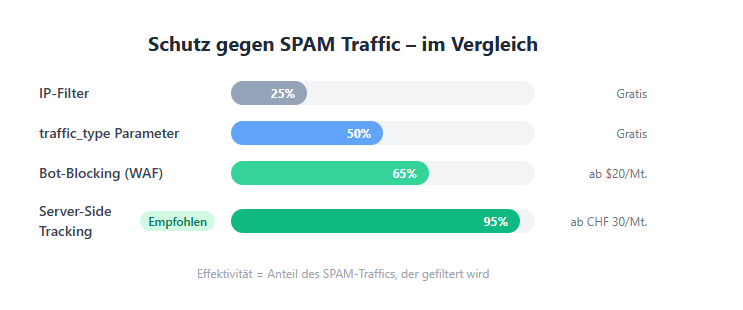

Es gibt verschiedene Ansätze, um SPAM Traffic zu bekämpfen. Keine davon ist perfekt – deshalb hier eine ehrliche Einordnung.

Hier haben wir die Lösungen für dich im Detail erklärt und nochmals genau unter die Lupe genommen.

Lösung 1: IP-Filter in GA4

So funktioniert’s:

Du definierst IP-Adressen von bekannten Bots (z.B. von deiner Consent Management Platform) und schliesst sie in GA4 aus.

Vorteile:

- Schnell eingerichtet

- Kostenlos

- Funktioniert für bekannte, stabile IPs

Grenzen:

- IP-Adressen ändern sich

- Manuelle Pflege nötig

- Ghost-Traffic (der nie deine Website besucht) wird nicht erfasst

Fazit: Gut als erste Massnahme, aber nicht nachhaltig.

Lösung 2: traffic_type-Parameter (Client-Side)

So funktioniert’s:

Du setzt im Google Tag Manager einen Parameter «traffic_type = nospam» und erstellst in GA4 einen Filter, der nur Traffic mit diesem Parameter einschliesst.

Vorteile:

- Schnell umsetzbar (wenige Minuten)

- Filtert Ghost-Traffic, der direkt an GA4 gesendet wird

- Keine laufenden Kosten

Grenzen:

- Bots, die deine Website tatsächlich aufrufen, werden nicht gefiltert

- Der Parameter ist im Browser sichtbar – Spammer könnten ihn auslesen

- Interner Traffic-Filter wird überschrieben

Fazit: Guter Einstieg, aber nicht wasserdicht. Detaillierte Anleitung bei ANALYTICSkiste

Lösung 3: Bot-Blocking (Cloudflare/WAF)

So funktioniert’s:

Du blockierst verdächtigen Traffic bereits auf Server-Ebene, bevor er deine Website erreicht.

Vorteile:

- Blockt Traffic vor dem Website-Aufruf

- Entlastet deinen Server

- Skaliert automatisch

Grenzen:

- Konfigurationsaufwand

- False Positives möglich (echte Nutzer werden blockiert)

- Ghost-Traffic wird nicht erfasst

Fazit: Gute Ergänzung, aber keine vollständige Lösung.

Lösung 4: Serverseitiges Tracking (Server-Side Tracking)

So funktioniert’s:

Der Tracking-Request geht nicht mehr direkt vom Browser an Google, sondern über deinen eigenen Server. Du hast die volle Kontrolle darüber, welche Daten an GA4 gesendet werden.

Vorteile:

- Effektivste Lösung gegen SPAM

- Volle Kontrolle über die Daten

- Datenschutzkonform (First-Party-Cookies)

- Bot-Detection auf Server-Ebene (z.B. mit Simple Bot Detector)

- Bessere Datenqualität insgesamt

Grenzen:

- Höhere Komplexität bei der Einrichtung

- Laufende Kosten (min. CHF 30/Monat für Google Cloud)

- Technisches Know-how oder Agentur erforderlich

- Wartungsaufwand

Für wen eignet sich SST (noch) nicht?

- Sehr kleine Websites mit minimalem Traffic

- Unternehmen ohne Budget für Einrichtung und laufende Kosten

- Websites ohne ernsthaftes Tracking-Bedürfnis

Unsere Empfehlung:

Serverseitiges Tracking ist die nachhaltigste Lösung – aber sie muss zur Situation passen. Bei unseren Marketing-as-a-Service-Mandaten ist SST bereits im Angebot enthalten. Für reine SST-Einrichtungen rechnen wir mit ca. CHF 1’500 Einrichtungskosten plus die laufenden Server-Kosten.

Was mit sauberen Daten möglich wird

Jetzt kommt der spannende Teil: Was kannst du tun, wenn deine Daten endlich stimmen?

1. Fundierte Marketingentscheidungen

Du weisst endlich, welche Kampagnen wirklich funktionieren – nicht welche von Bots «besucht» wurden. Budget-Verteilung wird zur strategischen Entscheidung statt zum Glücksspiel.

2. Echte Conversion-Optimierung

Wenn deine Engagement-Metriken stimmen, kannst du echte Probleme identifizieren. Vielleicht ist dein Checkout-Prozess tatsächlich ein Problem – oder vielleicht war es nur der SPAM, der die Zahlen nach unten zog.

3. Valide A/B-Tests

Mit sauberen Daten liefern deine Tests statistisch signifikante Ergebnisse. Du kannst Entscheidungen treffen, die auf echtem Nutzerverhalten basieren.

4. KI-gestützte Analysen

Wir setzen zunehmend auf KI, um Muster in Marketingdaten zu erkennen. Das funktioniert nur mit sauberer Historie. SPAM-Ausschläge verfälschen jede Prognose.

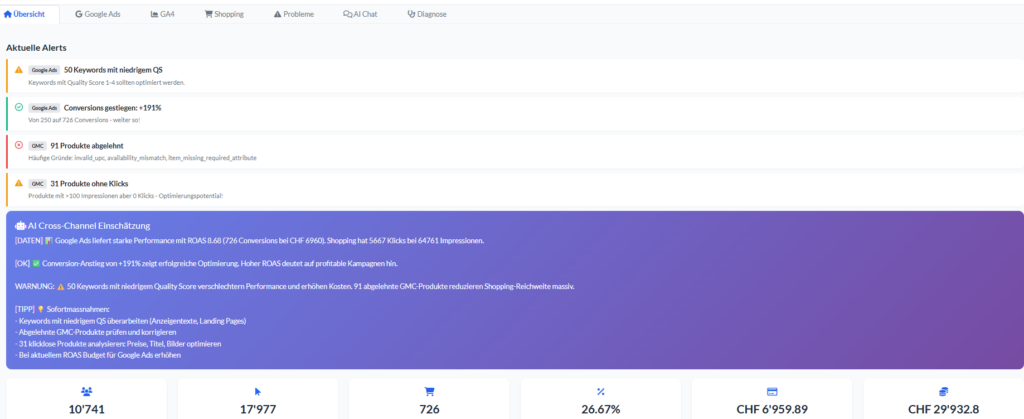

So nutzen wir KI bei cloudWEB

Bei cloudWEB haben wir ein eigenes Dashboard entwickelt, das genau hier ansetzt. Wir verbinden die Rohdaten aus BigQuery mit R und Claude – und lassen die KI eine automatische Cross-Channel-Einschätzung erstellen.

Was das Dashboard kann:

- Automatische Alerts: Die KI erkennt Probleme wie Keywords mit niedrigem Quality Score, abgelehnte Produkte im Google Merchant Center oder Conversion-Änderungen – und meldet sie proaktiv.

- AI-Einschätzung in Klartext: Statt nur Zahlen zu zeigen, erklärt die KI, was die Daten bedeuten. Im Beispiel: «ROAS 8.68 deutet auf profitable Kampagnen hin» – aber auch: «91 abgelehnte Merchant Center-Produkte reduzieren Shopping-Reichweite massiv.»

- Konkrete Handlungsempfehlungen: Die KI gibt direkt umsetzbare Tipps – welche Keywords überarbeitet werden sollten, welche Produkte geprüft werden müssen.

- AI Chat für Ad-hoc-Fragen: Über den integrierten Chat kannst du jederzeit Fragen zu deinen Daten stellen – ohne selbst in GA4 oder Google Ads zu suchen.

Der Haken: Das funktioniert nur, wenn die Datenbasis stimmt. Wenn SPAM-Traffic deine GA4-Daten verfälscht, kann die KI falsche Einschätzungen liefern. Deshalb ist saubere Datenqualität die Grundvoraussetzung für jede KI-gestützte Analyse.

5. Glaubwürdige Reports

Wenn du der Geschäftsleitung Zahlen präsentierst, kannst du dahinterstehen. Keine nachträglichen Korrekturen, keine Erklärungen à la «das waren leider Bots».

Fazit: Daten sind Entscheidungsgrundlage – oder Zeitverschwendung

Viel Traffic bedeutet nichts, wenn die Daten nicht stimmen.

SPAM Traffic ist kein Randproblem mehr – es ist ein systematisches Risiko für jede datengetriebene Marketingstrategie. Die gute Nachricht: Mit den richtigen Massnahmen lässt sich das Problem lösen.

Deine nächsten Schritte:

- Prüfe deine GA4-Daten auf die beschriebenen Warnsignale

- Implementiere IP-Filter für bekannte Bot-Quellen (schneller Einstieg)

- Setze den traffic_type-Parameter für zusätzlichen Schutz

- Evaluiere serverseitiges Tracking für nachhaltige Datenqualität

- Dokumentiere deine Datenqualitäts-Standards – wer prüft was, wann?

Du weisst jetzt, wie du SPAM Traffic erkennst und bekämpfst. Vorher waren deine Daten vielleicht unzuverlässig. Jetzt hast du die Werkzeuge, um das zu ändern.

Wir bei cloudWEB helfen dir gerne bei der Umsetzung – ob schnelle Erstmassnahmen oder vollständiges Server-Side-Tracking-Setup. Melde dich einfach bei uns.

Wie sauber sind deine GA4-Daten wirklich?

Finde es heraus – mit unserem kostenlosen Google Analytics Audit. Wir analysieren dein Setup, identifizieren SPAM-Traffic und zeigen dir konkrete Handlungsempfehlungen.

FAQ – Häufig gestellte Fragen zu SPAM Traffic in GA4

Filtert Google nicht automatisch Bot-Traffic?

Ja, aber nur bekannte Bots gemäss der IAB-Liste. Viele Spammer umgehen diese Erkennung bewusst. Laut Imperva sind 47,4% des Internet-Traffics Bots – Google erkennt davon nur einen Teil.

Was kostet serverseitiges Tracking?

Die Einrichtung liegt bei ca. CHF 1’500. Dazu kommen laufende Kosten von mindestens CHF 30/Monat für die Google Cloud plus Wartungsaufwand. Bei Marketing-Mandaten ist SST bei uns oft bereits im Angebot enthalten.

Kann ich SPAM Traffic nachträglich aus GA4 löschen?

Nein. GA4 erlaubt keine nachträgliche Löschung von Daten. Du kannst aber Segmente erstellen, die SPAM ausschliessen, und diese für deine Analysen verwenden.

Wie erkenne ich, ob mein Traffic SPAM ist?

Achte auf: Mehr neue als aktive Nutzer, extrem kurze Interaktionsdauer (unter 10 Sekunden), Traffic-Spikes ohne erklärbare Ursache, verdächtige Referral-Quellen, Traffic aus Ländern, die du nicht bedienst.

Reicht der traffic_type-Filter als Schutz?

Für einen Grossteil des Ghost-Traffics ja. Aber Bots, die deine Website tatsächlich besuchen, werden nicht gefiltert. Für vollständigen Schutz empfehlen wir serverseitiges Tracking.

Ist serverseitiges Tracking für jede Website sinnvoll?

Nicht zwingend. Für sehr kleine Websites ohne ernsthaftes Tracking-Bedürfnis kann der Aufwand unverhältnismässig sein. Sobald du jedoch Marketingentscheidungen auf Basis deiner Daten triffst, lohnt sich die Investition.